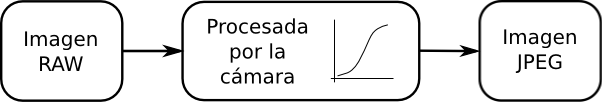

Ha llegado el momento de tocar uno de esos temas más «polémicos» de la fotografía digital, ¿Cómo exponer para sacar el máximo rendimiento en cuanto a calidad a nuestra cámara? Básicamente esto se conseguir empleando la técnica que se denomina «derechear el histograma» (exposing to the right (ettr)). Y pongo polémico, por que desde que el tema ha sido introducido por primera vez por Michael Reichmann en su famosa página Luminous Landscape, después de unas largas discusiones con Thomas Knoll (creador de Adobe Photoshop, Adobe Camara Raw, y Adobe Lightroom), no ha generado más que debates en foros a lo largo de todo internet.

En este primer artículo sobre el tema simplemente voy a introducir el problema, para que más adelante en futuras entradas en este blog, explicar las ventajas y desventajas, demostraciones gráficas, y como emplear la técnica en vuestras cámaras.

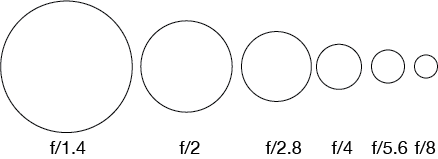

El asunto nace después de pensar en como funciona un sensor digital. Supongamos que nuestra cámara digital tiene un rango dinámico de unos 5 pasos de luz (es decir, entre el tono más oscuro al tono más claro puede almacenar cinco pasos de luz, cualquier valor fuera de ese rango será blanco puro o negro puro), y que al disparar en RAW (no tiene sentido usar esta técnica en JPEG), la cámara es capaz de almacenar 12 bits de información (realmente el manual y la cámara os van a decir que es 16 bits, pero raramente una cámara es capaz de distinguir tantos bits, sencillamente almacenan 12 bits en un archivo que puede llegar almacenar 16). Entonces con estos 12 bits, la cámara sería capaz de distinguir 4096 (2^12) tonos diferentes.

Lo lógico sería pensar que el sensor digital que tiene nuestra cámara repartiría esos 4096 valores de forma uniforme entre los 5 pasos de luz que es capaz de almacenar. Es decir, cada paso de luz la cámara, bajo esta suposición, sería capaz de almacenar 850 tonos distintos. Y aquí es donde viene el problema. El sensor digital no funciona de esta forma, el sensor digital, ya emplee tecnología CCD o CMOS, es un dispositivo lineal. Básicamente esto quiere decir que cada paso de luz que es capaz de almacenar, almacena el doble de luz que el anterior, y por lo tanto el doble de información. ¿Qué significa esto? Pues que para nuestro ejemplo la cámara funcionaría de la siguiente forma.

| Paso de Luz | Tonos que distingue |

|---|---|

| Para el primer paso de luz, que contiene los tonos más oscuros | 128 tonos distintos |

| Para el segundo paso de luz, que contiene los tonos oscuros | 256 tonos distintos |

| Para el tercer paso de luz, que contiene tonos intermedios | 512 tonos distintos |

| Para el cuarto paso de luz, que contiene tonos brillantes | 1024 tonos distintos |

| Para el quinto paso de luz, que contiene los tonos más brillantes | 2048 tonos distintos |

La tabla anterior lo que nos está indicando es que cuanto más a la derecha tengamos nuestro histograma, más tonos diferentes vamos a ser capaces de almacenar en nuestra imagen y mayor calidad tendrá la fotografía final, sobretodo en la zona de sombras.

Otra forma de entender esto, es que cuanto más tiempo este capturando luz nuestro sensor, sin que este se sature, es decir, nos empiece a quemar la fotografía, más información está capturando, con lo cual la relación señal/ruido es mucho mejor dando lugar a una imagen final de mayor calidad.

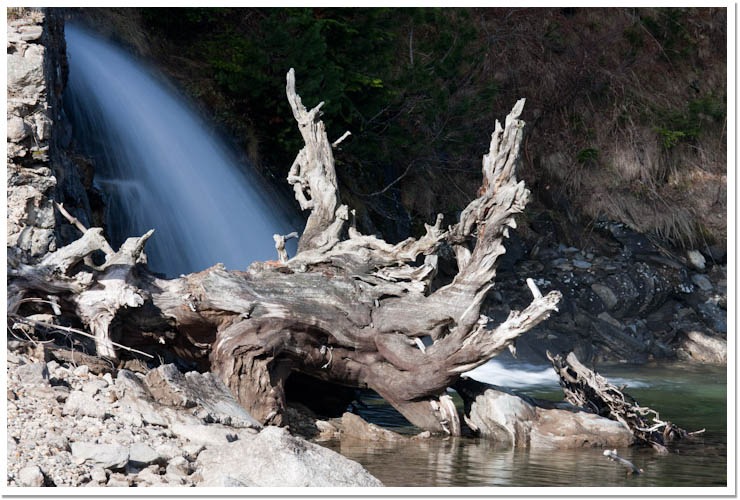

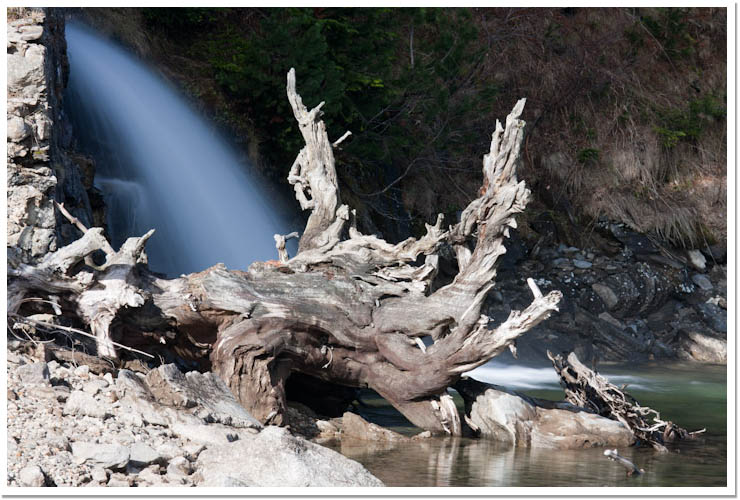

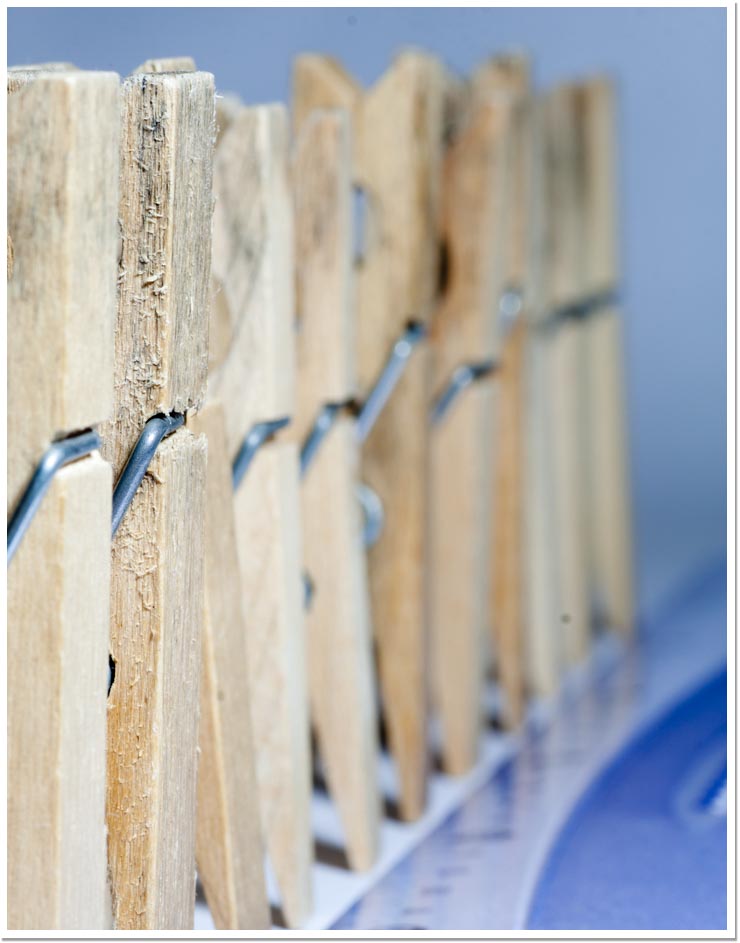

El principal problema, es que cuando abramos dichas imágenes en nuestro revelador RAW favorito, o las veamos en la pantalla de la cámara, veremos una imagen como lavada, muy brillante. El primer paso que tendremos que hacer es básicamente ajustar el histograma, por eso, en los ejemplos que suelo poner por aquí, lo primer que digo es que ajusto el punto de blanco y negro, para que mi imagen empiece a tomar el aspecto que deseo de ella, con la mayor calidad posible.

Cómo todo esto siempre se entiende mejor con un ejemplo, en el siguiente artículo que continua esta serie se centrará en una pequeña demostración gráfica de esta técnica.